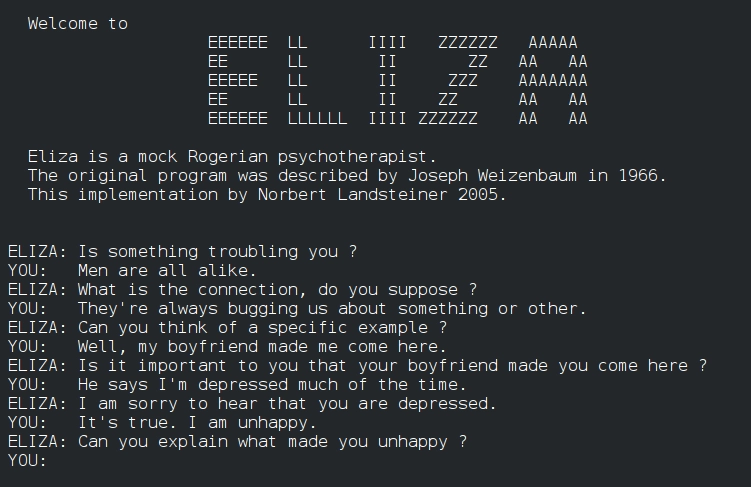

用戶:男人全都一個樣。

聊天機械人:在哪些方面?

用戶:他們總是為這為那來煩我們。

聊天機械人:你能想到一個具體的例子嗎?

用戶:那個,是我男朋友讓我來這兒的。

聊天機械人:你的男朋友讓你來這兒的?

用戶:他說我大部份時間都顯得情緒低落。

聊天機械人:聽到你情緒低落,我感到很難過。

人們或許會以為這段對話發生在ChatGPT與人類用戶之間,而該對話實際發生在20世紀60年代,對話雙方是一個名為ELIZA的電腦程序和一名人類。作為ChatGPT的前身,ELIZA的功能儘管相對有限,但它仍能夠與人類對話者進行流暢的模擬對話——而這在世紀之交很久之前就已存在了。ELIZA現今被公認為首個聊天機械人,也可理解其為當今ChatGPT等大語言模型的「曾祖母」。

有關ELIZA故事的耐人尋味之處,是它的程式員——如同瑪麗·雪萊筆下的維克多·弗蘭肯斯坦一樣——很快察覺出其創作中潛藏的危險,並在職業生涯之後的大部份時間裏,不停向世人發出有關人工智能(AI)的警告。他同時也批評了一些人工智能領域先驅所倡導的技術主義和後人類主義世界觀。

這位程式員的名字叫維森鮑姆(Joseph Weizenbaum,1923~2008)。他是一位在年少時期逃離納粹德國的德裔美國科學家,也是早期人工智能領域的一位重要人物——然而,其後來卻成為了該領域最嚴厲的批評者之一。

ELIZA的起源

維森鮑姆於1966年的一篇期刊文章中發表了開篇的對話記錄,並在其中解釋了ELIZA的工作原理。本質上,ELIZA模仿了羅傑斯心理治療(Rogerian psychotherapy)的形式。在治療過程中,通常會由患者來主導對話。治療師通過穿插提問或簡單陳述,來幫助患者進行更深層的自我覺察。對於一個學會模擬對話,而又缺乏生成原創文本能力的初始聊天機械人來說,這種模式堪稱完美。

ELIZA會提取用戶語句中的特定關鍵詞,例如「我」「你」或「母親」。這些詞語會觸發相應機制,令機械人以一句話或提問作為回應。而回應通常是將用戶使用的一些詞語套入到一個回覆模板中。這進而會給人一種錯覺,彷彿機械人真的在針對用戶表述的內容進行回覆。如果用戶寫道「我很難過」(I am sad),機械人可能會回覆:「你難過多久了?」(How long have you been sad?)。「難過」這個詞的具體含義並不重要,聊天機械人只是簡單地將這個詞從用戶的語句中複製過來。對於「抑鬱」「開心」「憤怒」或任何其它形容詞,這一方式同樣適用。如果ELIZA在用戶的表述中沒有捕捉到任何關鍵詞,它便會生成一個通用回覆,比如「我明白了」或「請繼續」。

這種體驗的效果極其逼真。維森鮑姆在其1966年的期刊文章中指出,某些實驗對象「極難被說服」去相信ELIZA並非人類。事實上,當他讓秘書測試該系統時,後者要求維森鮑姆離開房間,以便她能私下與這位「治療師」繼續交談。維森鮑姆自此發現了一種後被稱為「ELIZA效應」的現象:即人類對無生命機器進行情感投射的傾向。

維森鮑姆意識到,這種賦予ELIZA(以及其它機器)人性或人格的衝動,並不僅僅發生在他的秘書身上。當一些精神科醫生大肆宣揚ELIZA(或其變體)可在治療用途上具有實際意義時,他意識到了事情的嚴重性。維森鮑姆對有人會將真實的心理健康問題託付給這樣一個「玩具」感到震驚。

對ELIZA機械的算法運作機制的深入了解,使他堅決反對將其應用於真正的治療手段。在他看來,這個系統就像手持計算器一樣呆板且毫無意識,對人類生活給不出任何見解。他認為此類想法簡直是「荒唐透頂」。

ELIZA效應開始讓維森鮑姆心神不寧,並令他開始重新審視人類與技術關係的前提。1998年的一次專訪揭示了維森鮑姆思想的深度和敏銳。期間維森鮑姆表明其對「機械論世界觀」的批判,他認為正是這種觀點支持著「用機器取代人類」的嘗試。

「這些(推崇人工智能的)作者以及其他人,正在千禧年之際鼓吹一種極其危險的人類形象。」他在採訪中向珀克森(Bernhard Pörksen)表示。

「這種形象建立在這樣一種觀念上:人的本質是一台機器,而在不久的將來,人類可以被充份理解和解碼,從而對其進行修正和改進。這種人類觀的核心理論是:生活中的方方面面都是可計算的(computable),意味著生活可被拆分為可計算和可公式化的過程。」

在採訪中,維森鮑姆提及了當時興起的超人類主義(Transhumanism)理論,他認為該理論基礎源自對人性和現實的根本性謬誤。人工智能的熱衷者們夢想創造出「更優型號」的人類——即「人類2.0」。他們認為這會促成人類向更高層級的跨越,即使這意味著要讓「人類1.0」走向消亡。維森鮑姆擔心,這些理論家和科學家正帶著一種準宗教式的心理,準備將「今日之人」犧牲在「未來之人」的祭壇上。此外,他還將唯物主義科學稱為「當今主導世界的宗教」。

通過將人類降格為機器,並將機器提升為神,維森鮑姆擔心人工智能的支持者正在使人「非人化」。他還將其與二戰時期的納粹言論進行了類比。

他解釋道:「我相信,國家社會主義(納粹主義)與人工智能理論家莫拉維克(Hans Moravec)思想之間的本質共同點在於對人的貶低,乃至不惜一切代價創造出『完美的全新人類』的幻想。」

對全人類的威脅

維森鮑姆的感想源於親身經歷,他和家人在目睹了納粹的暴行後,於1935年從德國逃往了美國。

然而,對技術的盲目崇拜或將比納粹主義有毒的意識形態更具災難性,因為它的終極目標不是某一特定族群,而是全人類。維森鮑姆指出,在這種對「完美人類」的瘋狂追求之後,「人類將不復存在」。

維森鮑姆可能會贊同C·S·劉易斯的觀點:「人性將是自然領域中最後向人類屈服的⋯⋯這場戰鬥終究會取得勝利。但究竟是誰贏了呢?人類最終的征服結果會是人類自身的毀滅。」

對維森鮑姆而言,人類形象的錯誤解讀比任何人類武器都更具危險性。而這種錯誤形象往往是導致使用武器的動機;它本身不是劍,卻是揮劍的手臂。他從「人與機器的模糊對等」中看到了巨大的危機。將兩者視為對等,無疑踐踏了人的尊嚴和對生命的敬畏,僅將人身等同於「肉身機器」。

他解釋道:「我們可以從這個世紀(20世紀)——或許是最殘暴的一個世紀當中汲取教訓,了解人類形象在過往罪行中扮演了怎樣決定性的角色。要記住,那些令人髮指的罪行之所以成為可能,正是因為加害者否定了受害者的人性。」

維森鮑姆的反對者將「通過機器智能優化人性」的希望,建立在這樣一個假設上:人類、人類行為和人類經驗最終都將能被完全量化、理解並解決——從而被複製和改進。而維森鮑姆堅持認為,人乃至人所在的宇宙永遠無法被完全解釋得清,因此也永遠無法被「破解」。

「世界充滿了奧秘,而人工智能界那種『萬物皆可計算』的信條否認了生命的神秘性。」他說。「它製造了一種一切可控的幻覺,並認為我們生活的方方面面都能被隨意操控。」

儘管維森鮑姆的警告在當時許多人看來,不過是一個古板怪老頭的無知,但在今天,這些話語卻越發顯得振聾發聵。

未曾間斷的警世恆言

在ELIZA出現後的幾十年裏,特別是在其1976年出版《電腦能力與人類理性:從判斷到計算》(Computer Power and Human Reason: From Judgment to Calculation)之後,維森鮑姆對人工智能的堅決抵制使他成了學術界和科學界的異類。

他在書中寫道:「有些任務是不能交給電腦去做的,這與電腦能否完成這些任務無關。」

維森鮑姆公開反對麥卡錫和閔斯基(Marvin Minsky)的觀點。這兩位都是1956年達特茅斯會議的發起者,而該會議也標誌著人工智能研究的開始。麥卡錫和閔斯基都成為了人工智能研究的先驅,而該領域在早期主要由美國軍方資助。麥卡錫與同事們推進相關研究的同時,曾嚴厲抨擊維森鮑姆的書「通篇說教且語無倫次」。而維森鮑姆的警告在當時基本上被置若罔聞。

時至今日,聊天機械人的先進程度已遠超當年的ELIZA,這使我們更容易掉入認知陷阱,將這些機器視為與我們人格對等的存在。我們看到有人認為聊天機械人具有意識,有人愛上了機械人,甚至有人被機械人慫恿自殺。

這些都會讓維森鮑姆感到悲哀。他的女兒米里亞姆(Miriam)在接受《史密森尼》(Smithsonian)雜誌採訪時表示,她的父親「會發覺這出悲劇——人們執迷於實質上的『0』和『1』,執迷於一連串代碼」。

維森鮑姆在1988年從其任教的麻省理工學院退休,並於1996年搬回德國。在那裏,他的觀點找到了更多志同道合的聽眾。維森鮑姆於2008年逝世。

內省、憂鬱並善於自我批判的同時,維森鮑姆也是一個堅定且擁有神秘直覺得人。他以一種比任何數學推理都更為確定的態度,感知著世界的奇妙和奧秘。在「0」和「1」之外,在齒輪、輪軸和原子之外,還有著更多我們未知的事物。在我們自身和親身經歷中,總有一些事物將脫離預測、自動化和計算的掌控。

維森鮑姆對這些體驗異常敏感。

他跟珀克森提到:「人們會有悲傷和震驚的體驗,清晨時會感到突如其來的喜悅,以及人與人之間會感到的友愛。而這些都是奇蹟,你無法準確去描述它。你要像藝術家那樣,才能去深刻體會它。」

在《電腦能力與人類理性》一書中,維森鮑姆描述了這樣一個人與人之間愛與聯結的時刻。

他寫道:「當我的孩子們還小時,我有時會和妻子一起俯身站在他們睡覺得床邊。我們彼此交談,卻無需言語;那是人類歷史上不斷上演的古老場景。」

維森鮑姆認為,那一時刻的某些事物早已超越了語言,更不用說算法了。

「我確信存在某種不可言說的東西,一種無法付諸文字的生命真理。」他寫道。

這種神秘主義傾向讓維森鮑姆成為了一部份人心目中的英雄,卻也讓他成了另一些人的笑柄。然而,一個人不一定要認同維森鮑姆的精神直覺,才能體會其基於常識的憂慮。儘管人工智能有著越發驚人的能力,但它們在道德上是惰性的,並缺乏我們每個人內心深處的良知。也正因如此,人工智能不應被給予可做出道德判斷的主導權。

用維森鮑姆自己的話來說便是:「最基本的原則在於,既然我們並無方法讓電腦充滿智慧,那麼我們就不應賦予其那些需要智慧才能勝任的任務。」

這一挑戰同樣值得身處這個時代的我們深思。#

原文:He Built the First Chatbot—Then Spent His Life Warning the World About AI 刊登於英文《大紀元時報》。

-------------------

局勢持續演變

與您見證世界格局重塑

-------------------

🔔下載大紀元App 接收即時新聞通知:

🍎iOS:https://bit.ly/epochhkios

🤖Android:https://bit.ly/epochhkand

📰周末版實體報銷售點👇🏻

http://epochtimeshk.org/stores