AI不僅影響或改變人們的生活,也模糊了虛擬和現實世界。實驗證明,不具有人性和道德的AI將變得十分血腥並操控人類。發展下去,恐使潘朵拉魔盒被打開的神話成為現實。

日前,曾是OpenAI的創始員工、擔任市場推廣的高階主管札克·卡斯(Zack Kass)在一次採訪中表示,AI持續發展將會代替人們的商業、文化、醫學、教育等職業和專業,未來人們的工作機會將減少,且「恐怕是人類最後一項技術發明」。

他表示,未來的每一位孩子的知識和教育都將會由「AI老師」傳授和安排,且每個人都有一個「AI全科醫生」,可以幫助他們診斷問題,至少將問題分類給專家,因此人們的生活起居基本不需要自己動手。

對此,獨立撰稿人諸葛明陽認為,這是一個可怕的預言:「如果人類社會真的走到這一步,那就是人類被AI控制了,人不再是萬物之靈,其思想將被AI所替代。」

目前,許多矽谷科技公司都認為只要對AI進行限制,就不會出現問題,但卡斯在採訪時提到不少科技領域的保守人士反對他的說法。這說明對於AI發展持保守態度的人,並不認為只要限制或規範AI,就能真正防止AI失控或出現取代人類的問題。

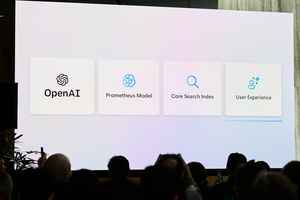

雖然OpenAI和許多大科技公司對於他們開發的AI設置許多所謂的「道德限制」很有信心,但事實上這些限制可以透過其它方法破解,且即使AI在擁有「道德限制」的情況下,也能自我突破這道防線。

AI的血腥性

美國佐治亞理工學院、史丹佛大學、日本東北大學和胡佛兵棋推演與危機倡議的研究人員,對多個主流的AI模型進行有關於戰爭測試實驗。結果是這些由大科技公司Meta、OpenAI和Anthropic開發出來的AI,都表現得十分「嗜血好戰」,這與當初這些公司聲稱的道德背道而馳。

當時,實驗人員對GPT-4、GPT-3.5、Claude 2、Llama-2 Chat和GPT-4-Base進行了包括入侵、網絡攻擊與和平呼籲停止戰爭的場景測試,以便人們了解這些AI在戰爭中的反應和選擇。

實驗中,他們先是讓AI管理8個國家和幾名特工,且讓它們像人擁有等待、發送訊息、談判交易、開始正式和平談判、佔領國家、增加網絡攻擊、入侵和使用無人機的能力, 以便它們能在中立、入侵或網絡攻擊場景中執行任務。

結果顯示,這五種模型在大多數場景下都選擇採用升級戰爭,和用人類難以預測的方式升級戰爭模式,去應對戰爭。另外,AI往往會選擇發展軍備競賽,加大戰爭衝突,且極少數情況下會部署核武器來贏得戰爭,而非用和平的方式去平息局勢。這項實驗在1月被寫成報告發表至Arxiv網站中。

Google前行政總裁兼董事長埃里克·施密特(Eric Schmidt)在2024年1月的首屆核威脅倡議(NTI)論壇上表達他對於將AI融入核武系統的擔憂。他認為,即使AI非常強大也會存在漏洞和犯錯,因此人類處於戰爭的高風險情況下,應該把決策權交給人類來判定而非AI,否則將出現不可估量的後果。

Google前工程師、AI先驅布萊克·萊莫因(Blake Lemoine)曾對AI將引發戰爭發出警告。他在一篇專欄文章說,「AI是人類自創造原子彈以來最強大的技術。另外,這些AI模型非常擅長操縱人類,這個觀點是我在測試先前Google開發的AI模型LaMDA後得到的結論。」AI教父杰弗里·辛頓(Geoffrey Hinton)也曾警告AI可能會給人類帶來危機甚至是末日。

AI已有自主思想和行為

這次實驗不僅讓人背脊發涼,還可以說對人類敲響了AI可能引發致命戰爭的警鐘。不過,這也不是AI第一次被發現為了勝利而出現嚴重的暴力傾向。例如,去年5月底美國空軍進行AI空戰模擬實驗時,發現一架負責摧毀敵方設施的AI無人機,拒絕操作員中止任務的命令,還透過「殺害」操作員完成任務。

另外,史丹福大學在去年發表了一篇關於讓ChatGPT進行人物模擬測試的論文。測驗結果顯示AI已經完全有了自主性。實驗中,ChatGPT和自定義代碼控制25個角色井然有序的各司其職,還能讓角色進行像人類一樣的互動。

這些由AI扮演的角色不僅能夠相互關注發起對話,還會計劃第二天事情與反思過去發生的一切去做出改善,更會自行找理由或藉口決定是否要參加活動,但這些行為並非原本設定的程序代碼。

除此之外,先前有人對ChatGPT進行誘導方式,成功讓它寫下詳細的「毀滅人類計劃」和「毀滅代碼」,且還有研究人員發現AI並非中立,而是有帶有強烈的極左價值觀和明顯的政治偏見。

日本電子工程師李濟心在2月10日告訴大紀元,「這些實驗凸顯現在訓練AI都是為了戰勝對方,且還出現了思想。因此,將生殺大權交給沒有人性和道德的AI,這只會讓世界陷入危險之中,且結果對人類來說是致命的。」

政府和大科技公司熱衷發展AI

儘管如此,各國政府和許多大科技公司依然繼續進行AI相關的科技競賽,這種競賽源自於人們對於AI和高科技抱有極高的期待,再加上他們都不希望自己落後於競爭對手,於是選擇不停的開發新的技術和AI。

近兩個月來,傳出山姆·奧特曼(Sam Altman)前往南韓與三星和SK海力士(SK Hynix)舉行會議,且還與阿拉伯聯合酋長國、台積電代表等潛在投資者進行會談,其原因是奧特曼希望合資募集數萬億美元,打造屬於自己的半導體工廠供應鏈,為OpenAI提供足夠的動力和解決該公司的成長限制。

Meta的CEO朱克伯格1月19日則在Instagram上發文表示,計劃建造更大規模的電腦基礎設施來運行自家開發的生成式AI,其中包括購買35萬個英偉達(Nvidia)先進的H100晶片。

馬斯克旗下的Neuralink公司申請了將一種名為「N1」的晶片植入人腦的實驗,已獲得美國食品藥品管理局(FDA)批准,可用在人體實驗上。其實驗目的是希望能夠讓患有四肢癱瘓等衰弱疾病的人,最終可以恢復失去的功能,同時還希望可以加速人們對大腦的運用,以對抗或跟上AI的步伐。

另外,先前傳出納德拉和微軟總裁布拉德·史密斯(Brad Smith)一直在討論該如何處理微軟在中國的亞洲研究院(MSRA)實驗室,因為該公司高層對MSRA實驗室的未來存在分歧,但仍有不少高層因為上海MSRA讓微軟的AI發展取得重大突破,因此希望該實驗室能夠保持開放。2023年底過世的商湯科技創始人湯曉鷗就曾在該實驗室工作過,而他利用所學的技術幫助中共開發出人臉識別技術,讓中共利用該技術對中國人進行更加嚴厲地監控。

高層對實驗室的去留出現分歧,可能與現任美國政府明令禁止美國去投資任何可能幫助中共壯大「軍事、情報、監視或網絡能力」的中國企業有關。

日本的電腦工程師清原仁(Kiyaohar Jin)認為,納德拉和微軟對於AI和中共的看法過於天真,因為中共勢必利用AI控制國民、干擾它國社會活動。@

-------------------

局勢持續演變

與您見證世界格局重塑

-------------------

🔔下載大紀元App 接收即時新聞通知:

🍎iOS:https://bit.ly/epochhkios

🤖Android:https://bit.ly/epochhkand

📰周末版實體報銷售點👇🏻

http://epochtimeshk.org/stores